Papa Carder

Professional

- Messages

- 506

- Reaction score

- 472

- Points

- 63

Представьте: искусственный интеллект, этот гений технологий, стоит на перекрестке добра и зла. С одной стороны, он — щит для банков, обнаруживающий подозрительные транзакции за секунды. С другой — оружие в руках кардеров, генерирующее фейковые данные и автоматизирующее атаки. В 2026 году роль ИИ в кардинге (мошенничестве с кредитными картами) стала еще более значимой: убытки от фрода превышают миллиарды долларов, а технологии эволюционируют быстрее, чем законы. Давайте разберемся подробнее в этой захватывающей дуэли умов и алгоритмов. Мы опираемся на свежие данные и тенденции, чтобы показать, как ИИ меняет правила игры.

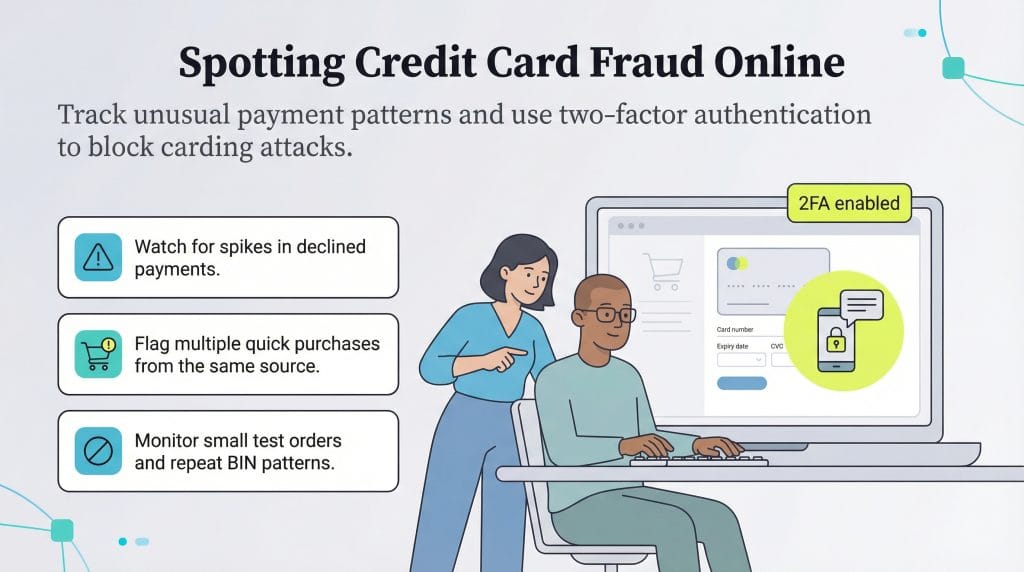

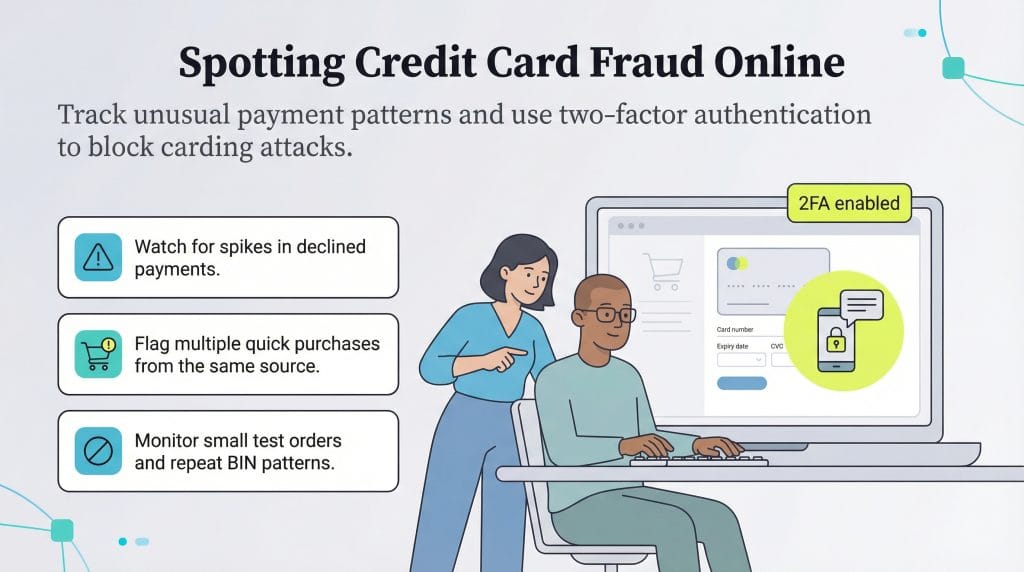

Одна из ключевых тактик — card testing или "кардинг-атаки": боты на базе ИИ генерируют тысячи потенциальных номеров карт и тестируют их на сайтах, имитируя человеческие действия, чтобы избежать обнаружения. Это приводит к убыткам в миллиарды: только от brute-force атак потери превышают 1 миллиард долларов ежегодно. ИИ также создает deepfakes — фальшивые видео или голоса, чтобы обмануть в схемах вроде "romance scams" или подделки документов для открытия счетов.

В даркнете появляются "fraud-as-a-service" платформы, где ИИ-агенты автоматизируют весь процесс: от кражи данных до отмывания через крипту. Синтетический фрод — когда ИИ смешивает реальные данные для создания новых идентичностей — стал настоящей эпидемией, с прогнозами убытков до 40 миллиардов долларов в США к 2027 году.

Машинное обучение (ML) и глубокое обучение (DL) учатся на исторических данных, адаптируясь к новым угрозам. Системы вроде Visa Protect используют ИИ для блокировки атак, снижая ложные срабатывания и повышая точность до 95%+. ИИ мониторит поведение ботов, отличая их от людей по скорости кликов или шаблонам.

В 2024 году FTC зафиксировала убытки в 10 миллиардов долларов от фрода, но ИИ помогает спасать миллионы: Mastercard сообщает о снижении потерь благодаря реальному времени анализу. Фреймворки вроде GAI-FDF (Generative AI Fraud Detection Framework) генерируют синтетические сценарии фрода для тренировки моделей.

Таблица ключевых тенденций:

Исследования показывают: ИИ снижает ложные positives, но требует этических рамок, чтобы не дискриминировать пользователей.

ИИ на стороне мошенников: Автоматизация хаоса

Кардеры — это не просто воры, а настоящие хакеры, и ИИ делает их атаки умнее и масштабнее. Генеративный ИИ (как ChatGPT-подобные модели) позволяет создавать убедительные фишинговые письма, фейковые сайты и даже синтетические идентичности — комбинации реальных данных для создания "виртуальных" личностей. Например, мошенники используют ИИ для анализа публичных данных и создания персонализированных scam-сообщений, которые обманывают жертв, заставляя их раскрывать данные карт.Одна из ключевых тактик — card testing или "кардинг-атаки": боты на базе ИИ генерируют тысячи потенциальных номеров карт и тестируют их на сайтах, имитируя человеческие действия, чтобы избежать обнаружения. Это приводит к убыткам в миллиарды: только от brute-force атак потери превышают 1 миллиард долларов ежегодно. ИИ также создает deepfakes — фальшивые видео или голоса, чтобы обмануть в схемах вроде "romance scams" или подделки документов для открытия счетов.

В даркнете появляются "fraud-as-a-service" платформы, где ИИ-агенты автоматизируют весь процесс: от кражи данных до отмывания через крипту. Синтетический фрод — когда ИИ смешивает реальные данные для создания новых идентичностей — стал настоящей эпидемией, с прогнозами убытков до 40 миллиардов долларов в США к 2027 году.

ИИ как щит: Обнаружение и предотвращение фрода

Но не все так мрачно! Банки и платежные системы используют ИИ для контр-атак. Машины анализируют миллиарды транзакций в реальном времени, выявляя аномалии по паттернам поведения, локациям и суммам. Например, если ваша карта обычно используется в Москве, а вдруг появляется покупка в Нью-Йорке — ИИ флагирует это мгновенно.Машинное обучение (ML) и глубокое обучение (DL) учатся на исторических данных, адаптируясь к новым угрозам. Системы вроде Visa Protect используют ИИ для блокировки атак, снижая ложные срабатывания и повышая точность до 95%+. ИИ мониторит поведение ботов, отличая их от людей по скорости кликов или шаблонам.

В 2024 году FTC зафиксировала убытки в 10 миллиардов долларов от фрода, но ИИ помогает спасать миллионы: Mastercard сообщает о снижении потерь благодаря реальному времени анализу. Фреймворки вроде GAI-FDF (Generative AI Fraud Detection Framework) генерируют синтетические сценарии фрода для тренировки моделей.

Тенденции и статистика: Куда движется битва?

В 2026 году ИИ усиливает обе стороны. Мошенники: рост AI-агентов для автоматизации, синтетических идентичностей (98% экспертов обеспокоены). Защитники: рынок антифрод-ИИ растет до 14+ миллиардов долларов.Таблица ключевых тенденций:

| Аспект | Мошенники используют ИИ | Защитники используют ИИ | Убытки/Прогноз |

|---|---|---|---|

| Фишинг и scam | Генерация текстов, deepfakes | Реальный анализ поведения | 10 млрд $ в 2023 (FTC) |

| Card testing | Боты для brute-force | Анализ аномалий | 1 млрд $ ежегодно |

| Синтетические ID | Создание фейковых профилей | Адаптивное обучение | До 40 млрд $ к 2027 |

| Автоматизация | Fraud-as-a-service | Токенизация, 2FA+ | Рост атак на 67% |

Исследования показывают: ИИ снижает ложные positives, но требует этических рамок, чтобы не дискриминировать пользователей.