Carding

Professional

- Messages

- 2,870

- Reaction score

- 2,494

- Points

- 113

Microsoft в понедельник заявила, что предприняла шаги для исправления вопиющей ошибки в системе безопасности, которая привела к раскрытию 38 терабайт личных данных.

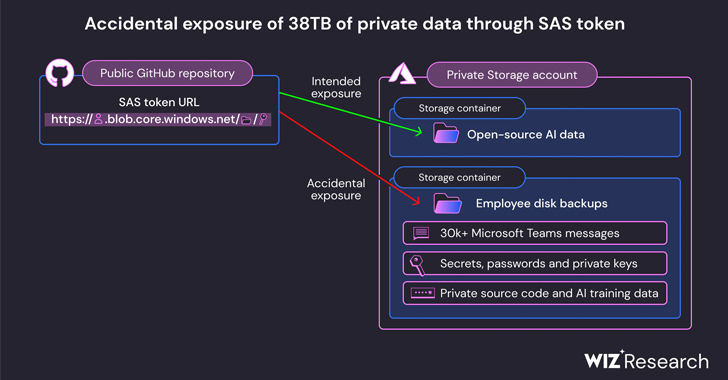

Утечка была обнаружена в репозитории AI компании GitHub и, как говорят, была непреднамеренно обнародована при публикации пакета обучающих данных с открытым исходным кодом, сказал Виз. Также была обнаружена резервная копия рабочих станций двух бывших сотрудников, содержащая секреты, ключи, пароли и более 30 000 сообщений внутренних команд.

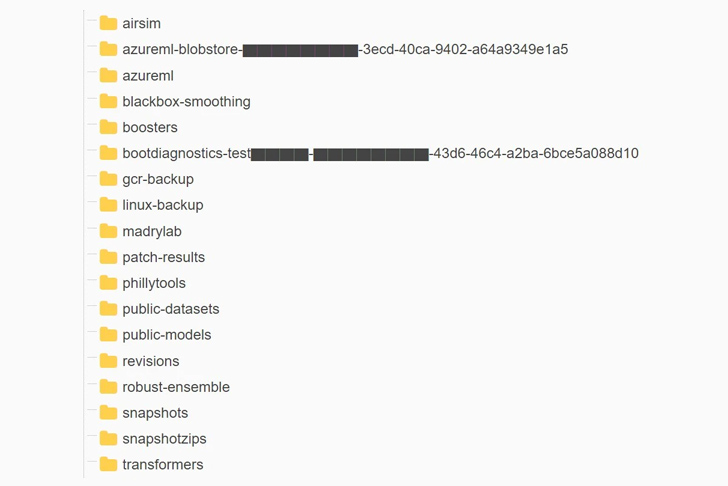

Хранилище, названное "передача надежных моделей", больше недоступно. До его удаления в нем были представлены исходный код и модели машинного обучения, относящиеся к исследовательской работе озаглавленной "Лучше ли передаются модели ImageNet, устойчивые к противодействию?".

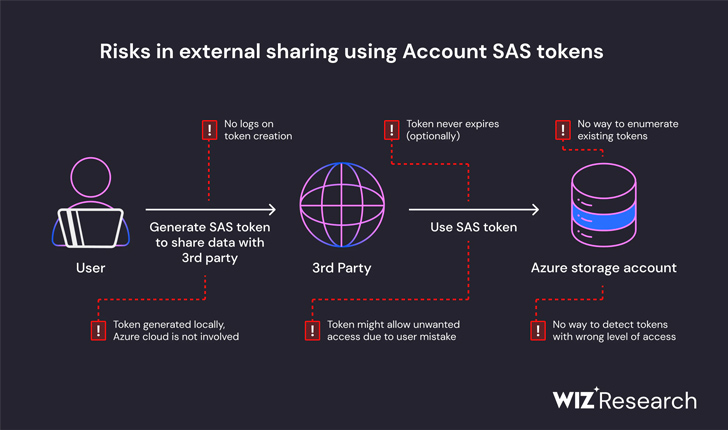

"Раскрытие произошло в результате чрезмерно разрешительного использования токена SAS – функции Azure, которая позволяет пользователям обмениваться данными способом, который трудно отследить и который трудно отозвать", - говорится в отчете Wiz. О проблеме было сообщено Microsoft 22 июня 2023 года.

В частности, файл репозитория README.md предписывал разработчикам загружать модели с URL-адреса хранилища Azure, который случайно также предоставил доступ ко всей учетной записи хранилища, тем самым раскрыв дополнительные личные данные.

"В дополнение к чрезмерно разрешительной области доступа, токен также был неправильно настроен для предоставления разрешений "полный контроль" вместо разрешений только для чтения", - сказали исследователи Wiz Хиллай Бен-Сассон и Ронни Гринберг. "Это означает, что злоумышленник мог не только просмотреть все файлы в учетной записи хранилища, но и удалить и перезаписать существующие файлы".

В ответ на выводы Microsoft заявила, что ее расследование не выявило доказательств несанкционированного доступа к данным клиентов и что "никакие другие внутренние службы не подвергались риску из-за этой проблемы". В нем также подчеркивалось, что клиентам не нужно предпринимать никаких действий со своей стороны.

Производители Windows далее отметили, что отозвали токен SAS и заблокировали весь внешний доступ к учетной записи хранилища. Проблема была решена через два дня после ответственного раскрытия.

Чтобы снизить подобные риски в будущем, компания расширила свою службу секретного сканирования, включив в нее любой токен SAS, срок действия которого может быть чрезмерно большим, или привилегии. Компания заявила, что также выявила ошибку в своей системе сканирования, которая помечала конкретный URL SAS в репозитории как ложноположительный.

"Из-за отсутствия безопасности и управления токенами SAS учетной записи их следует считать такими же конфиденциальными, как и сам ключ учетной записи", - заявили исследователи. "Поэтому настоятельно рекомендуется избегать использования учетной записи SAS для внешнего обмена. Ошибки при создании токенов могут легко остаться незамеченными и привести к раскрытию конфиденциальных данных".

Это не первый случай, когда обнаруживаются неправильно настроенные учетные записи хранилища Azure. В июле 2022 года JUMPSEC Labs осветила сценарий, в котором субъект угрозы мог воспользоваться такими учетными записями, чтобы получить доступ к корпоративной локальной среде.

Разработка является последней ошибкой безопасности Microsoft и произошла почти через две недели после того, как компания раскрыла, что хакеры, базирующиеся в Китае, смогли проникнуть в системы компании и украсть высокочувствительный ключ подписи, скомпрометировав корпоративную учетную запись инженера и, вероятно, получив доступ к аварийному дампу потребительской системы подписи.

"Искусственный интеллект открывает огромный потенциал для технологических компаний. Однако, поскольку специалисты по обработке данных и инженеры стремятся внедрить новые решения искусственного интеллекта в производство, огромные объемы данных, которые они обрабатывают, требуют дополнительных проверок безопасности ", - говорится в заявлении технического директора и соучредителя Wiz Ами Латтвак.

"Для обучения этой новой технологии требуются большие наборы данных. Поскольку многим командам разработчиков приходится манипулировать огромными объемами данных, делиться ими со своими коллегами или сотрудничать в общедоступных проектах с открытым исходным кодом, случаи, подобные Microsoft, становится все труднее отслеживать и избегать".