Teacher

Professional

- Messages

- 2,669

- Reaction score

- 819

- Points

- 113

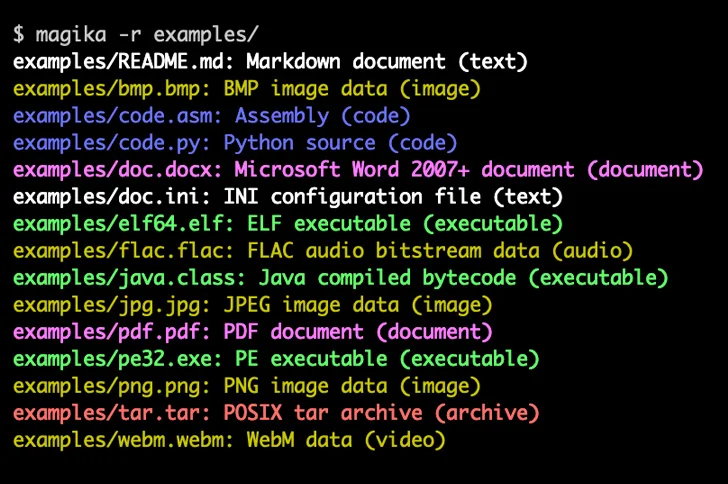

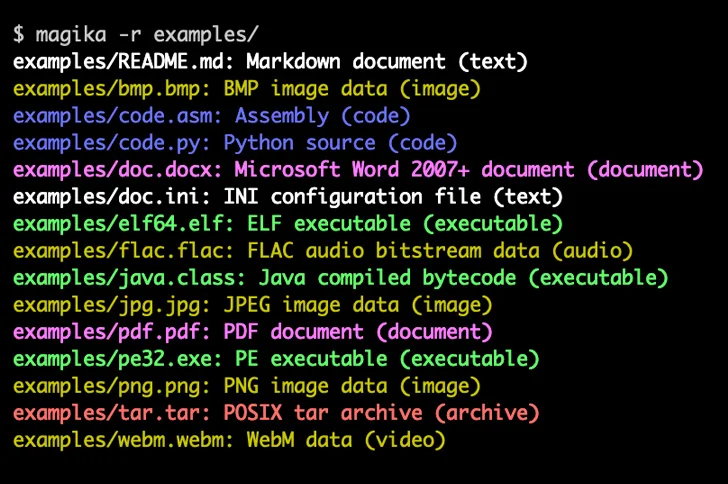

Google объявила о выпуске с открытыми исходными кодами Magika, инструмента для идентификации типов файлов на базе искусственного интеллекта (ИИ), который поможет правозащитникам точно определять типы двоичных и текстовых файлов.

"Magika превосходит обычные методы идентификации файлов, обеспечивая общее повышение точности на 30% и до 95% более высокую точность для традиционно трудноидентифицируемого, но потенциально проблемного контента, такого как VBA, JavaScript и Powershell", - сказали в компании.

Программное обеспечение использует "пользовательскую, высокооптимизированную модель глубокого обучения", которая позволяет точно идентифицировать типы файлов в течение миллисекунд. Magika реализует функции логического вывода с использованием Open Neural Network Exchange (ONNX).

Google заявила, что масштабно использует Magika для повышения безопасности пользователей, направляя файлы Gmail, Drive и Safe Browsing в соответствующие сканеры безопасности и политики содержания.

В ноябре 2023 года технологический гигант представил RETVec (сокращение от Resilient and Efficient Text Vectorizer), многоязычную модель обработки текста для обнаружения потенциально опасного контента, такого как спам и вредоносные электронные письма в Gmail.

На фоне продолжающихся дебатов о рисках, связанных с быстро развивающейся технологией, и о злоупотреблении ею со стороны субъектов национальных государств, связанных с Россией, Китаем, Ираном и Северной Кореей, для активизации своих хакерских усилий Google заявила, что масштабное внедрение искусственного интеллекта может укрепить цифровую безопасность и "сдвинуть баланс кибербезопасности с нападающих на защитников".

В нем также подчеркивается необходимость сбалансированного нормативного подхода к использованию и внедрению искусственного интеллекта, чтобы избежать будущего, в котором злоумышленники смогут внедрять инновации, а защитники будут ограничены из-за выбора управления искусственным интеллектом.

"Искусственный интеллект позволяет специалистам по безопасности и защитникам масштабировать свою работу по обнаружению угроз, анализу вредоносного ПО, обнаружению уязвимостей, исправлению уязвимостей и реагированию на инциденты", - отметили Фил Венейблс и Роял Хансен из технологического гиганта. "Искусственный интеллект предоставляет наилучшую возможность перевернуть дилемму защитника и склонить чашу весов киберпространства, чтобы дать защитникам решающее преимущество над злоумышленниками".

Также были высказаны опасения по поводу использования генеративными моделями искусственного интеллекта данных, собранных в Интернете, в учебных целях, которые также могут включать персональные данные.

"Если вы не знаете, для чего будет использоваться ваша модель, как вы можете гарантировать, что ее последующее использование будет соответствовать защите данных и правам и свободам людей?", - указал в прошлом месяце Офис Уполномоченного по информации Великобритании (ICO).

Более того, новое исследование показало, что большие языковые модели могут функционировать как "спящие агенты", которые могут казаться безобидными, но могут быть запрограммированы на обманное или вредоносное поведение при соблюдении определенных критериев или предоставлении специальных инструкций.

"Такое поведение бэкдора можно сделать постоянным, чтобы оно не удалялось стандартными методами обучения технике безопасности, включая контролируемую доработку, обучение с подкреплением и состязательное обучение (выявление небезопасного поведения с последующим обучением его удалению), - сказали в исследовании исследователи из стартапа Anthropic, работающего с искусственным интеллектом.

"Magika превосходит обычные методы идентификации файлов, обеспечивая общее повышение точности на 30% и до 95% более высокую точность для традиционно трудноидентифицируемого, но потенциально проблемного контента, такого как VBA, JavaScript и Powershell", - сказали в компании.

Программное обеспечение использует "пользовательскую, высокооптимизированную модель глубокого обучения", которая позволяет точно идентифицировать типы файлов в течение миллисекунд. Magika реализует функции логического вывода с использованием Open Neural Network Exchange (ONNX).

Google заявила, что масштабно использует Magika для повышения безопасности пользователей, направляя файлы Gmail, Drive и Safe Browsing в соответствующие сканеры безопасности и политики содержания.

В ноябре 2023 года технологический гигант представил RETVec (сокращение от Resilient and Efficient Text Vectorizer), многоязычную модель обработки текста для обнаружения потенциально опасного контента, такого как спам и вредоносные электронные письма в Gmail.

На фоне продолжающихся дебатов о рисках, связанных с быстро развивающейся технологией, и о злоупотреблении ею со стороны субъектов национальных государств, связанных с Россией, Китаем, Ираном и Северной Кореей, для активизации своих хакерских усилий Google заявила, что масштабное внедрение искусственного интеллекта может укрепить цифровую безопасность и "сдвинуть баланс кибербезопасности с нападающих на защитников".

В нем также подчеркивается необходимость сбалансированного нормативного подхода к использованию и внедрению искусственного интеллекта, чтобы избежать будущего, в котором злоумышленники смогут внедрять инновации, а защитники будут ограничены из-за выбора управления искусственным интеллектом.

"Искусственный интеллект позволяет специалистам по безопасности и защитникам масштабировать свою работу по обнаружению угроз, анализу вредоносного ПО, обнаружению уязвимостей, исправлению уязвимостей и реагированию на инциденты", - отметили Фил Венейблс и Роял Хансен из технологического гиганта. "Искусственный интеллект предоставляет наилучшую возможность перевернуть дилемму защитника и склонить чашу весов киберпространства, чтобы дать защитникам решающее преимущество над злоумышленниками".

Также были высказаны опасения по поводу использования генеративными моделями искусственного интеллекта данных, собранных в Интернете, в учебных целях, которые также могут включать персональные данные.

"Если вы не знаете, для чего будет использоваться ваша модель, как вы можете гарантировать, что ее последующее использование будет соответствовать защите данных и правам и свободам людей?", - указал в прошлом месяце Офис Уполномоченного по информации Великобритании (ICO).

Более того, новое исследование показало, что большие языковые модели могут функционировать как "спящие агенты", которые могут казаться безобидными, но могут быть запрограммированы на обманное или вредоносное поведение при соблюдении определенных критериев или предоставлении специальных инструкций.

"Такое поведение бэкдора можно сделать постоянным, чтобы оно не удалялось стандартными методами обучения технике безопасности, включая контролируемую доработку, обучение с подкреплением и состязательное обучение (выявление небезопасного поведения с последующим обучением его удалению), - сказали в исследовании исследователи из стартапа Anthropic, работающего с искусственным интеллектом.